Título: De la neurona de Cajal a la superinteligencia artificial: paralelismo cerebral-artificial

Autor: Rubén F. Hernán-Gómez (Servicio de Neurología, Hospital Universitario Puerta de Hierro de Majadahonda, Madrid, España).

Fuente: Publicado originalmente en Kranion, revista sobre Neurología y Neurohumanidades. DOI: 10.24875/KRANION.M25000096.

(Introducción/Resumen) Esta revisión narrativa es mucho más que un viaje por las vidas de aquellas personas que han contribuido al desarrollo de la IA moderna. Mediante un análisis en profundidad de la mutua influencia entre la neurología y las ciencias de la computación, se pone de manifiesto cómo las redes neuronales artificiales no son más que el intento del homo sapiens de recrear el mayor sistema inteligente conocido hasta el momento: el cerebro humano. Beneficios trascendentales, desafíos crecientes y riesgos inquietantes convergen en torno a la indómita estela de la Cuarta Revolución Industrial.

Histor de Dos Neuronas: Los Pioneros

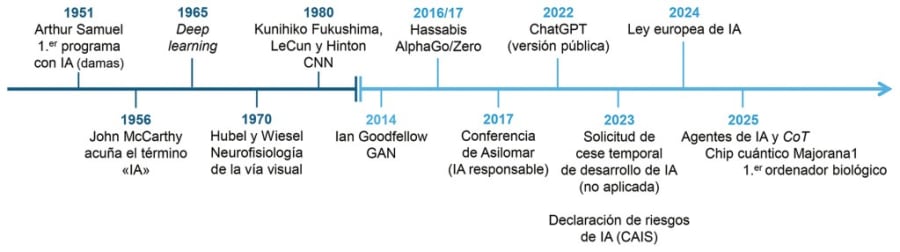

La historia de la inteligencia artificial (IA) se remonta a los albores de la ciencia. A continuación, se presenta un recorrido por algunas de las figuras clave que impulsaron su evolución.

-

Santiago Ramón y Cajal (1852-1934): Padre de la neurociencia moderna, demostró la individualidad de la neurona (la doctrina neuronal) e introdujo conceptos como la direccionalidad de los impulsos nerviosos y la plasticidad neuronal. Su trabajo es el pilar sobre el que se inspirarían los primeros modelos de neuronas artificiales.

-

Warren McCulloch (1898-1969) y Walter Pitts (1923-1969): Inspirados en los descubrimientos de Cajal, crearon el modelo neuronal de McCulloch-Pitts. Este pretendía simular digitalmente una neurona biológica, sentando las bases de las futuras redes neuronales artificiales (ANN).

-

Rafael Lorente de Nó (1902-1990): Discípulo directo de Cajal, propuso un modelo no lineal del córtex cerebral basado en circuitos con conexiones recurrentes y bucles de retroalimentación, contribuciones que serían decisivas para la computación moderna.

-

Alan Turing (1912-1954): Considerado el fundador de las ciencias de la computación y la IA, su intención final era construir ordenadores capaces de imitar al cerebro humano. Creó el famoso Test de Turing como medida de la inteligencia de una máquina y describió con gran acierto campos de aplicación como el ajedrez, la traducción o la criptografía.

-

John McCarthy (1927-2011): Acuñó el término “inteligencia artificial” en 1956.

-

Geoffrey Hinton (1947-): Galardonado con el Premio Nobel de Física en 2024, sus investigaciones permitieron optimizar las redes neuronales en áreas como el análisis masivo de datos y el descubrimiento de patrones de forma autónoma.

-

Yann LeCun (1960-): Especializado en aprendizaje profundo, sus aportaciones han sido clave para potenciar las redes neuronales convolucionales (CNN), especialmente en el reconocimiento de imágenes y texto manuscrito.

-

Demis Hassabis (1976-): Fundador de DeepMind (propiedad de Google), es el creador de AlphaGo, el programa que venció a los mejores jugadores del mundo. También desarrolló AlphaFold2, una IA que predice la estructura 3D de las proteínas, por la que recibió el Premio Nobel de Química en 2024.

¿Puede una máquina pensar? El Vínculo entre Neurociencia e IA

La pregunta que formuló Alan Turing en su ensayo de 1950, “Computing Machinery and Intelligence”, sigue vigente. La neurociencia y la IA comparten un fuerte vínculo bidireccional. La arquitectura cerebral es el gran plano en el que se inspiran los modelos de IA, aunque imitar el funcionamiento de mil billones de sinapsis es un reto monumental.

Neurofisiología Artificial: Un Paralelismo Detallado

La IA moderna busca recrear las funciones del cerebro. A continuación, exploramos las analogías más directas.

-

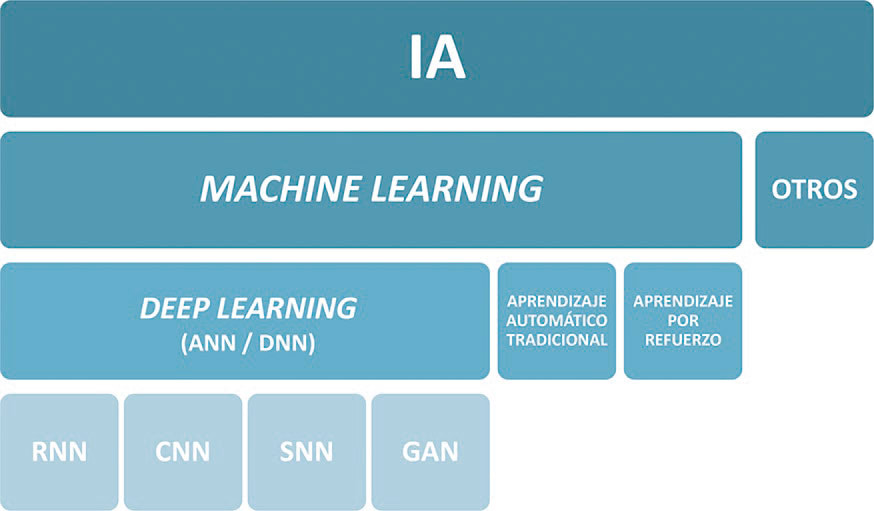

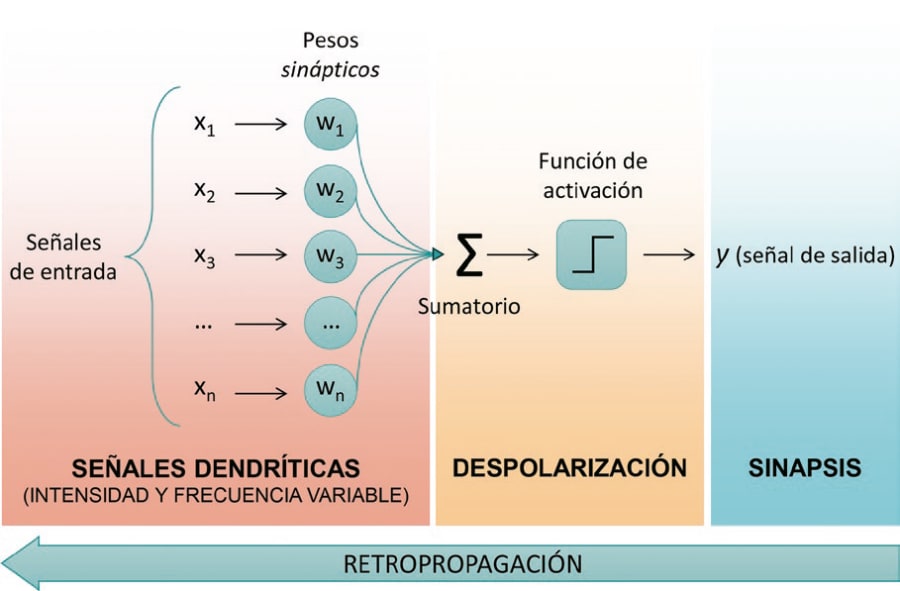

Neurona vs. Perceptrón: Así como la neurona es la unidad del sistema nervioso, la neurona artificial (o perceptrón) es el componente clave del aprendizaje profundo. Un perceptrón pondera múltiples entradas, las suma y aplica una función para decidir si emite una señal, imitando la despolarización y sinapsis de una neurona biológica.

-

Memoria: El cerebro humano utiliza redes neuronales difusas para la memoria. La IA lo emula con Redes Neuronales Recurrentes (RNN), que usan conexiones repetitivas para mantener y recuperar información a lo largo del tiempo, algo esencial para tareas como la traducción.

-

Visión: El cerebro procesa la información visual de forma jerárquica, desde contornos simples hasta conceptos abstractos. Las Redes Neuronales Convolucionales (CNN) imitan este proceso, siendo expertas en clasificar y analizar imágenes, como las radiografías médicas.

-

Lenguaje: Considerada la gran ventaja evolutiva humana, el lenguaje es procesado por los Grandes Modelos de Lenguaje (LLM). Estos sistemas, como GPT o Gemini, se basan en probabilidad estadística para predecir la siguiente palabra, pero carecen de una comprensión semántica real de lo que expresan.

-

Atención: En humanos, la atención depende de complejos circuitos cerebrales. La IA replica esto mediante la arquitectura de transformadores (la base de los LLM modernos), que asignan distinta relevancia a las partes de la información de entrada, emulando la atención biológica. El artículo seminal que la propuso se titula, acertadamente, “Attention Is All You Need”.

-

Aprendizaje y Plasticidad: El aprendizaje en el cerebro surge de la plasticidad sináptica. La IA lo simula con algoritmos como la retropropagación, un flujo de información en sentido inverso que ajusta los “pesos sinápticos” de la red para corregir errores.

Patología Artificial: Cuando la IA “Enferma”

Los sistemas de IA también presentan fenómenos análogos a déficits neurológicos:

-

Alucinaciones: Ocurre cuando un modelo genera información incorrecta o incoherente, pero aparentemente verosímil.

-

Pareidolia: La tendencia humana a ver patrones (como caras) en imágenes ambiguas también ocurre en las CNN entrenadas para reconocer objetos. Modelos como DeepDream de Google usan este fenómeno de forma creativa.

-

Opacidad (La “Caja Negra”): Al igual que es un enigma el impacto de cada cambio sináptico en el cerebro, es extremadamente difícil saber con exactitud por qué una IA toma una decisión concreta.

El Horizonte Tecnológico: Destellos de la Singularidad

El objetivo final de muchos investigadores es la Inteligencia Artificial General (AGI), un sistema capaz de resolver cualquier problema y aprender de su experiencia hasta superar al ser humano. Cuando esto ocurra, se alcanzará la singularidad tecnológica: el momento en que el progreso tecnológico se vuelva incontrolable al volverse nuestra creación completamente independiente.

A pesar de los avances, la IA aún enfrenta desafíos como adquirir conocimiento intuitivo o reducir su enorme consumo energético. Además, existen riesgos claros: magnificación de sesgos, desestructuración laboral, filtración de datos y pérdida de soberanía humana por delegación en sistemas automáticos.

El Futuro es Ahora: Las Últimas Revoluciones

El ritmo del cambio es vertiginoso. Algunas de las novedades más recientes parecen sacadas de la ciencia ficción:

-

Computación Cuántica: Microsoft ha presentado Majorana, el primer chip cuántico diseñado para resolver tareas imposibles para los ordenadores actuales.

-

Computación Biológica: La empresa Cortical Labs anunció CL1, el primer ordenador biológico comercial que fusiona circuitos de silicio con una red neuronal orgánica cultivada sobre ellos.

-

Agentes de IA y Corporeidad: Robots humanoides como NEO Gamma, de la empresa 1X, ya usan IA para realizar tareas domésticas. A su vez, agentes de software como los que desarrolla OpenAI pueden controlar de forma autónoma un ordenador para ejecutar tareas complejas a petición de un usuario.

Conclusión: Ctrl+Alt+Supr

La IA es neurotecnología en sí misma, y el único indicio sólido de que una AGI es posible yace en el interior de nuestro propio cerebro. Sin embargo, si como sociedad no establecemos límites claros, corremos el riesgo de que la primera entidad superinteligente que inventemos sea también lo último que creemos jamás. ¿Sabremos identificar, si fuera necesario, el momento preciso para pulsar el botón de apagado de emergencia?. A estas y muchas otras cuestiones, solo el tiempo podrá darles respuesta.

Comentarios

Para activar los comentarios: ve a giscus.app, introduce el repositorio

joseadserias-dotcom/cajal-digitaly reemplaza los IDs ensrc/layouts/Articulo.astro.